ディープラーニング(深層学習)の技術は、人工知能の発展の上で大きな貢献を見せています。ディープラーニングはここ数年で開拓されてきた技術ではあるものの、そのポテンシャルは高く、世界中でより優れた学習能力の向上を目指す研究が進んでいます。

そして、ディープラーニングの性能向上に役立っているのが、GPUです。PCを利用していると耳にすることも多いGPUですが、これはどのようにディープラーニングへ役立っているのでしょうか?

今回は、GPUがディープラーニングのパフォーマンスを高める上で、重要な役割を果たす理由について紹介していきます。

ディープラーニングの仕組み

まずは、ディープラーニングの仕組みが具体的にどうなっているのかというところから、改めて確認しておきましょう。ディープラーニングは、基本的に「ニューラルネットワーク」と呼ばれる仕組みを利用して、人工知能の学習能力を向上させるアプローチです。

人間の記憶や学習効果は、いくつもの神経細胞が互いに信号を送り合うことで形成されています。これを人工的に再現し、コンピューターにも応用できないかということで始まったのがニューラルネットワークです。

ニューラルネットワークは、人間の神経細胞のネットワークを再現するべく、「入力層」「隠れ層」「出力層」という3層から成立しています。これらの層においては別個の処理が並列的に行われており、一つの結果を出力するのに複数の側面から情報処理を行っているというわけです。

また、ディープラーニングはこの3層の厚みが増せば増すほど、その精度も高まるとされています。近年ではこの層を複数層用意できるようになったことで、ディープラーニングの学習能力が飛躍的に向上するようになりました。

コンピューターが対象を識別するのに欠かせない特徴量を、ディープラーニングによって自発的に導けるだけでなく、人間よりもはるかに正確に見出すことができるようになったのです。

ディープラーニング・人工知能(AI)・機械学習の違い

ディープラーニングを話題にする上で、忘れてはならないのが関連キーワードとの差別化です。ディープラーニングとともに紹介されやすい「人工知能」や「機械学習」といった言葉との違いについても確認しておきましょう。

人工知能(AI)とは

人工知能(AI)は、コンピュータープログラムの一種で、人間のように自律的な思考化が可能なモデルのことを指しています。

従来のコンピュータープログラムというのは、自律的な思考ができない、あらかじめ指定された作業をただ実行するだけのものでした。例えば、四則演算を100回繰り返すことには長けているものの、そこから効率の良い計算方法を見出したり、新しい答えの可能性について考察する能力は備わっていなかったのです。

一方で、人工知能の場合は、従来のコンピューターの強みである高い計算能力はそのままに、自律的に施工する力を獲得しています。

例えば、倉庫作業における検品作業です。これまで、商品に不具合があるかどうかは人間が目で確かめることが当たり前でしたが、これは検品に伴う作業工程が複雑で、「良し悪し」の判断を自ら下さなければならないためです。

しかし、人工知能を搭載したコンピューターであれば、商品の良し悪しの基準を自ら把握し、高速で検品作業を進めていくことができます。商品の状態に関するさまざまな要素を、人工知能によって判別できるようになったためです。

ディープラーニングは、そんな人工知能の活躍に不可欠な判断能力を、深い思考によってより高い精度に引き上げるサポートをしてくれます。複雑な学習ができるようになることで、人工知能はさらに高度な意思決定の現場や、正確な判別が求められる用途に活用することが可能になります。

機械学習とは

人工知能のパフォーマンスを決定づけるのが、どれだけ質の高い学習を行えたかどうかです。現在、人工知能へ効率的に学習させるためのアプローチとして主流なのが機械学習です。

機械学習は、特定のデータからコンピューターが反復的に学習を繰り返し、そこから目的に合わせたパターンを見つけ出すという学習方法です。人工知能の自律性を担保しているのは、この反復学習から自発的に正解のパターンを見つけ出すことができる点です。人工知能の精度は、機械学習の学習効率に依存しているとも言えるでしょう。

そして、従来とは異なるプロセスで反復学習を行うということで注目されているのがディープラーニングです。ディープラーニングには「深層学習」という和訳も存在しますが、カテゴリとしては機械学習の方法の一つと言うことができます。

ディープラーニングは、ニューラルネットワークという仕組みを用いて、効率的に反復学習を進められます。そのため、通常の機械学習よりも素早く学習を行えるため、精度の高い人工知能を短期間で構築するのです。

ディープラーニングがAI分野で注目される背景

続いて、ディープラーニングが人工知能(AI)開発の分野において、ここまで注目されるようになった背景について解説しておきましょう。人工知能の学習方法にはディープラーニング以外の方法もありますが、ここまで他の学習方法と注目度に差が生まれたのは、どのような理由があるのでしょうか?

ディープラーニングの有用性が証明されつつある

ディープラーニングは、その研究の歴史を辿ると1950年代にまで遡ります。アメリカの心理学者である、フランク・ローゼンプラットが「パーセプトロン」と呼ばれる、人間の脳や感覚機能を模したモデルが1957年に開発されて以来、世界中で研究が進められてきました。

「ディープラーニング」と呼ばれる学習方法が確立されたのは、2006年のことでした。現在採用されている多層ニューラルネットワークがこの段階で実現したために、ディープラーニング開発は一気に進められることとなったのです。

2012年、トロント大学の研究チームは人工知能(AI)を用いた物体の認識率を競う大会、ILSVRCにおいて、ディープラーニングを用いた人工知能を導入し、劇的な認識率の向上を実現しました。当時はまだディープラーニングの有用性については懐疑的であったものの、この大会以降、ディープラーニングはその知名度を高めていき、現在に至ります。

ハードウェアの進化

ディープラーニングは、大きな実績を残したことから注目されるようになった技術ですが、このような実績を生み出す上で貢献してくれたのがハードウェアの進歩です。ディープラーニングは運用できれば強力な学習効果を発揮してくれますが、以前はディープラーニングに耐えうるハードが非常に高価であったため、一般的な研究やビジネスの現場で使われることはありませんでした。

しかし、近年ではスマホの普及を始め、高性能なコンピューターを安価なハードでも扱えるようになってきました。そのため、ディープラーニングのような高度なプログラムの運用も比較的容易に行えるようになってきています。結果として、ディープラーニングはますます身近な技術として注目されるようになりました。

ディープラーニングの高速化で実現すること

ディープラーニングの高速化が進めば、複雑な学習も容易に進められ、より高度なAIの運用に活用することが可能です。ここでは、その一例を見ていきましょう。

高度な画像認識

ディープラーニングによって人工知能の性能が向上すれば、画像認識や映像認識の精度向上につながります。近年では、空港の税関やスマートフォンのセキュリティにも使用されているように、高度な顔認識機能も見かけるようになりました。

通常、これらを実現するためには膨大な量の人物データが必要になり、データを用意するコストはもちろん、それらを処理するための時間的なコストも発生します。

しかし、このような問題も、ディープラーニングの登場によって大幅に改善することができました。ニューラルネットワークの効率的な学習により、通常の機械学習と比べて格段に素早くデータを取り込み、高い精度のアルゴリズム構築が実現したためです。

ディープラーニングの活用によって、より多くの組織や研究者が容易に高度な画像認識を行えることとなりました。

自動運転

高いレベルの画像認識機能を活用できるようになれば、自動運転の実現も一段と近づきます。自動運転機能の実現が難しい理由の一つに、リアルタイムで映像を把握し、即座に判断を運転に反映させるという複雑なプロセスが発生するためです。

即座の意思決定の精度を高めるためには、まず人工知能が高速で映像を分析できるよう施さなければなりません。高度な画像・映像認識機能が実現することで、結果的に映像をもとにした意思決定が迅速になり、自動運転の実現に近づきます。

高度な意思決定

ディープラーニングによって確度の高い自律性を人工知能(AI)が獲得すれば、意思決定の現場でも活躍が期待できます。現在の人工知能の多くは、チャットボットや自然言語翻訳など、あくまでも作業の自動化の現場で活躍していることがほとんどです。

しかし、ディープラーニングによって複雑な要素を処理できるようになれば、人間の仕事とされてきた経営方針の採択など、重要な意思決定の現場でも活躍が可能です。

人工知能はあくまでもデータをもとにした予測や分析を行うため、主観的な判断やエゴが意思決定に反映される心配はありません。現在は投資などにも人工知能が用いられるケースも見られますが、将来的には企業経営も人工知能によって、部分的に行われる可能性もあるでしょう。

ディープラーニングにおいてGPUが重宝される理由

そんなディープラーニングの可能性をさらに引き出してくれるのが、GPUの存在です。GPUがディープラーニングを有効に扱う上で近年注目を集めているのには、どのような理由があるからなのでしょうか?

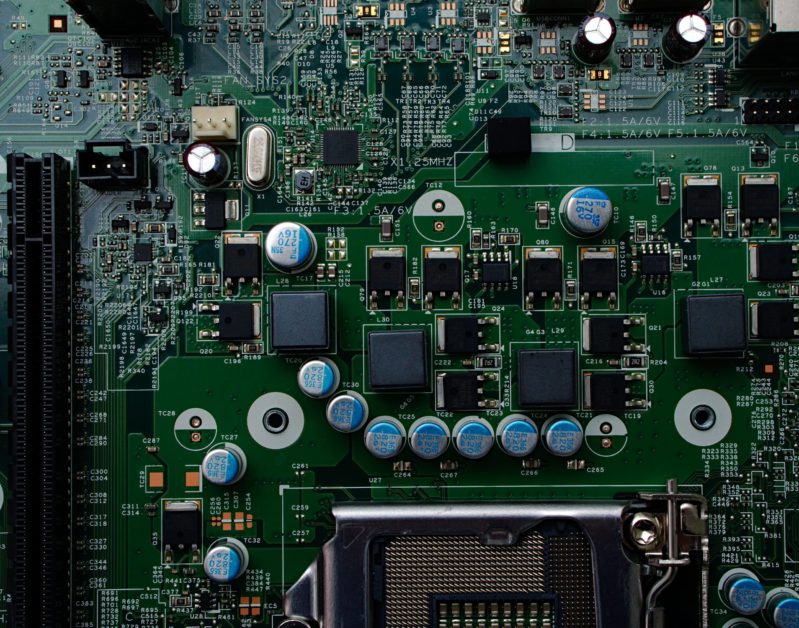

GPU本来の役割

そもそも、GPUはラップトップ(ノート)パソコンなど、私たちが日常的に使用するPCにも必ず搭載されているパーツです。GPUはGraphics Processing Unitの略称で、その名のとおりグラフィックをつかさどるプロセッサーです。

基本的に、PCの計算処理の多くはCPUが担当していますが、グラフィックの描画には大きな負荷が発生するため、GPUにその処理を任せています。GPUの性能が高くなればなるほど、精細な描画をスムーズに行うことができます。

すると、高画質でゲームを楽しむことはもちろん、高度な技術を要する映像編集や、3Dグラフィックの制作にも活用できるようになるというわけです。PCの性能が向上したことで美しいグラフィックを楽しめるようになったと言われていますが、より具体的に言えば、GPUの性能が上がったことで楽しめるということです。

並列処理能力が高いから

そんなグラフィックに強いGPUが、ディープラーニングの現場で重宝されているのは、GPU独自の並列処理能力の高さにあります。元々、グラフィックの処理というのは、他の計算処理とは異なり、同様の計算を一度に何回も行わなければならないものです。

通常のCPUは、異なる計算を素早くこなすことには最適な一方で、グラフィック処理のように膨大ながらも同様の計算を行う上では、やや非効率な設計となっています。そのため、グラフィックの処理に特化しているGPUは、同時に複数の計算を行えるよう設計されています。

いわゆる「並列処理」能力に優れるGPUは、一度にいくつもの計算を行えるために、繊細のグラフィック描写を実現しているというわけです。

ディープラーニングにおいては、この「並列処理」の能力の高さが必要となります。ディープラーニングの計算処理というのも、実はグラフィックの描写と同様、何度も同じような計算を行うというプロセスを踏むためです。

グラフィック特化と呼ばれてきたGPUですが、ディープラーニングが登場したことによって、GPUは一躍最先端技術を担う重要なハードとして注目されることとなりました。

GPUの進化も著しいから

GPUへの注目が高まる昨今、GPUそのものの進化も飛躍的な速度で進んでいます。毎年各メーカーから新しいモデルが発売され、PCでゲームを楽しむ人たちにはもちろんのこと、研究者たちからも注目の集まるところです。

毎年GPUを交換するとまではいきませんが、数年おきに新しいGPUを導入してみるのは非常に有効です。

ただ、ネックとなるのがGPUの価格です。GPUは最新のものを毎回導入するとなると非常に高額で、ましてやディープラーニングのように大量のリソースを必要とする環境を構築するとなると、常に最新のモデルを導入するのは難しいでしょう。

そこで活用したいのが、クラウドベースで利用可能な「クラウドGPU」の存在です。自前で用意せずとも、クラウドサービスを活用してGPUを導入できれば、多くのメリットを享受できます。

クラウドGPUを活用するメリット

クラウドGPUの活用は、通常のGPUリソースの導入とは異なり、オンラインで行うことになります。クラウドGPUならではのメリットを押さえておき、プロジェクトを優位に進められるようにしましょう。

常に最新のGPUへアップデートできる

クラウドGPUは、常に最新のGPU環境を利用できるのが強みです。オンプレミスのGPUの場合、導入当時こそ最新のモデルを活用できても、時間が経つにつれそのパフォーマンスの魅力は薄れてくるものです。

これはGPUが定期的に進化するためで、一つ世代を繰り上げるだけでも大きな違いが生まれることもありますが、毎年最新のGPUを導入するわけにはいきません。

そこで活用したいのが、クラウドGPUです。クラウドGPUでは、常に最新のGPU環境へのアップデートが行われていおり、ユーザーは常に最高の環境を構築することができます。

当社サービス「M:CPP」では、最新のAMD製GPUを導入しており、ユーザーにハイエンドの環境を提供しています。最新のGPUへの切り替えを考えている場合には、オンプレミスからクラウドGPUへの移行も効果的です。

導入コストが安い

クラウドGPUは、導入コストを抑えられることも強みの一つです。

オンプレミスの場合、GPUを導入するとなるとハードウェアの整備から始めなければならず、そのためには膨大な初期費用が発生します。これはGPUの新規導入はもちろん、買い替えの際にも発生し得るコストです。

また、オンプレミスの場合は利用できるようになるまである程度の日数が必要になることもあります。今すぐ必要なのに、環境整備に時間がかかっているようでは、タイトなスケジュールに対応することができません。

そして、GPUを自社で導入すれば、それらの保守運用に費用が発生します。導入だけでなく管理にもコストがかかるとなると、規模の小さな会社では大きな負担となります。

そこで、クラウドGPUの活用です。クラウドGPUはオンライン利用となるため、導入に際してはハードウェアを一から揃える必要はありません。そのため、初期費用はオンプレミスに比べて格段に安く抑えられ、負担の大きな軽減につながります。

また、費用はライセンス契約料金だけで賄われるため、管理コストが発生することもありません。大企業はもちろんのこと、中小企業にとっても力になれるサービスと言えるでしょう。

必要に応じて柔軟な導入ができる

クラウドGPUの良いところは、必要に応じて柔軟な導入ができる点にあります。先ほども触れたように、オンプレミスでのGPU運用は、費用負担だけでなく導入に時間がかかってしまうため、小回りの効く運用はできません。

オンプレミスでのGPU増設は、ほぼ不可逆的な取り組みです。「テスト開発のために、今だけGPUリソースを増やしたい」「ピーク時以外は必要はない」というニーズに対して応えられないのです。

そこで、クラウドGPUの活用です。クラウドGPUは必要に応じて契約するリソースを増やしたり、あるいは減らしたりすることもできるため、いつでも柔軟に導入できます。

必要に応じたリソースの確保がいつでも行えるので、必要な時は増設、いらない時は契約をしないという使い方ができ、管理コストの低下につなげられます。

BCP対策に向いている

またクラウドGPUは、何らかの災害が発生した際でも、業務を続けられるような環境を整える上で役立ちます。いわゆるBCP対策ですが、クラウドは特定の場所に仕事場を依存させず、インターネットさえあればどこでも作業ができるような環境を実現してくれる技術です。

GPUもオンプレミスであれば、常に業務が行えなくなるリスクと隣り合わせですが、クラウドGPUであればどこからでも業務を遂行できるため、万が一の事態にも対応できます。クラウドGPUの汎用性は、リモートワークなどの働き方改革を進める上でも役立ってくれるでしょう。

まとめ

GPUの高い並列処理能力は、ディープラーニングを効率化する上で大きな役割を担っています。また、ディープラーニングを効率的に行う上でも、クラウドGPUの汎用性の高さは魅力的です。新たにGPUの導入を検討している場合には、クラウドGPUの活用も視野に入れておくと良いでしょう。

GPUのクラウド利用を考えているは、当社のクラウドGPUサービス「M:CPP」を検討してみてください。

「大規模な開発を進めていく前に、一度コストを抑えてテストを行いたい」「オンプレミスのGPUの維持管理コスト負担が気になる」など、GPUの運用に関する課題を一気に解決することが可能です。大手GPUクラウドの費用負担に悩んでいる場合も、M:CPPであれば最適化とオールインワンパッケージの採用により、さらなるコスト削減を期待できるでしょう。

こちらの公式サイトから、チェックしてみてください。